Lucha contra la intolerancia en Internet contra grupos especialmente vulnerables. Monitoreo a gran escala y combate narrativo del odio en Internet en España (COIN)

Detectores de contenido de odio

Ejemplos de contenido de odio segundo dato

El estudio COIN, como parte del WP5 [D5.2 y D5.3], busca mapear y analizar el contenido de odio en las plataformas de redes sociales (Twitter (X), Facebook, Instagram y TikTok, dirigidos explícitamente a las comunidades judías, musulmanas, migrantes, LGBTI y romaníes. Esta investigación tiene un doble propósito: en primer lugar, monitorear y decodificar la naturaleza y la dinámica de la distribución del discurso de odio contra estos grupos sociales vulnerables, y en segundo lugar, explorar la interrelación entre las diversas formas de odio que afectan a individuos y comunidades. Se centra en las dinámicas interseccionales dentro de estos cinco grupos, examinando cómo las características específicas del odio se entrecruzan e intensifican su exclusión y discriminación.

Para ejecutar el paquete de trabajo 5, COIN emplea metodologías avanzadas de recopilación y análisis de datos, utilizando herramientas sofisticadas como algoritmos de detección de palabras y sistemas de análisis semántico para capturar y categorizar el discurso de odio en plataformas como Twitter, Facebook, Instagram y TikTok. Tras el entrenamiento de modelos de IA y la creación de sistemas de detección [D4.1], la recogida de datos se llevó a cabo durante un periodo definido [del 1 de abril al 13 de agosto de 2024], centrándose en los mensajes publicados en España (cuando fue posible) y en español. Este enfoque garantiza una contextualización cultural y lingüísticamente específica de los fenómenos de odio.

Objetivo general

El objetivo es mapear y analizar el contenido de odio dirigido a judíos, musulmanes, migrantes, grupos LGBTI y comunidades gitanas en plataformas de redes sociales como X (Twitter), Facebook, Instagram y TikTok. El estudio tiene como objetivo identificar la interseccionalidad de las características que provocan rechazo, reconociendo cómo diversas formas de odio pueden interrelacionarse dentro de los mensajes en línea analizados.

Categorización y evaluación de los discursos de odio

Este estudio computacional propuesto por COIN analiza los mensajes recopilados entre el 1 de abril y el 13 de agosto de 2024 de Facebook, X (Twitter), Instagram y TikTok. El análisis se centrará en un corpus de mensajes 610373 [Twitter (X): 42875; TikTok: 86372; Facebook: 409687; Instagram: 71439], categorizado en 17 categorías distintas diseñadas para capturar varias dimensiones y tipos de discurso de odio prevalentes en las redes sociales.

Inicialmente, se establecieron cinco categorías principales en función de la asociación de los mensajes con grupos específicos, incluidos judíos, romaníes, musulmanes, personas LGBTI e inmigrantes. El proceso de clasificación utilizará técnicas de reconocimiento de palabras clave dentro de los mensajes, lo que permite una segmentación precisa de acuerdo con el público objetivo o el grupo al que se hace referencia.

Además, el análisis se enriquecerá con doce categorías adicionales denominadas «variables latentes», diseñadas para capturar aspectos más sutiles y profundos del contenido. Entre estas, cinco categorías se centran específicamente en la detección de la «presencia de odio», utilizando detectores avanzados desarrollados durante las fases D4.1 y D4.2 del proyecto. Cada detector está diseñado para identificar una forma particular de odio: antigitano, antisemitismo, islamofobia, LGBTIfobia y xenofobia, lo que ofrece una herramienta sólida para discernir y cuantificar expresiones o tipos específicos de odio dentro del conjunto de datos.

Las seis categorías restantes se derivan de la integración con la API de Perspective [https://www.perspectiveapi.com/], una herramienta avanzada que proporciona indicadores de «toxicidad» en los mensajes. Esta tecnología permite la medición automática y en tiempo real de la toxicidad del lenguaje, ofreciendo información valiosa sobre la naturaleza y el tono del discurso en las plataformas digitales.

Por último, se integrará una categoría adicional de «sentimiento», utilizando el software SentiStrength para evaluar el tono emocional general de los mensajes. Esta variable proporcionará una comprensión más matizada de las emociones que subyacen en el contenido analizado, que van desde expresiones de odio hasta otros sentimientos que pueden moldear la percepción y la dinámica del discurso en línea.

Este enfoque multidimensional permite una comprensión integral de las dinámicas de comunicación en las redes sociales. Proporciona a los investigadores herramientas avanzadas para decodificar patrones de interacción digital complejos y diversos, allanando el camino para intervenciones más informadas e impactantes en la esfera digital.

Hipótesis/preguntas de investigación

COIN investiga el discurso de odio en las redes sociales, guiado por varias hipótesis y preguntas de investigación que exploran la dinámica de cómo el odio se manifiesta e impacta a varios grupos vulnerables. Las hipótesis presentadas en D5.2 y D5.3 tienen como objetivo detectar la presencia de odio al mismo tiempo que examinan sus intersecciones, correlaciones y repercusiones sociales más amplias.

- Interseccionalidad

Hipótesis: Diferentes tipos de discurso de odio, como la islamofobia y la xenofobia, a menudo se superponen en los mensajes en línea, dirigiéndose a múltiples grupos vulnerables simultáneamente y creando un daño compuesto.

Objetivo: Identificar y cuantificar los casos en los que el discurso de odio dirigido a un grupo (por ejemplo, los musulmanes) se superpone con el odio contra otro grupo (por ejemplo, los inmigrantes), y analizar el impacto de esta interseccionalidad en la intensidad y la propagación del odio.

Esta investigación se centra en la hipótesis de la interseccionalidad, que explora la convergencia de múltiples formas de odio dentro de los mensajes individuales. Su objetivo es determinar si los diferentes tipos de odio se dirigen simultáneamente a grupos específicos. El objetivo es identificar y cuantificar los casos en los que, por ejemplo, el odio contra los musulmanes se superpone con el odio contra los inmigrantes, descubriendo así patrones de odio interseccionales que pueden ser especialmente dañinos y reveladores.

El estudio tiene como objetivo identificar la prevalencia de mensajes que contienen múltiples formas de odio, como aquellos que expresan simultáneamente hostilidad hacia musulmanes e inmigrantes o que combinan el odio contra la comunidad LGBTI con sentimientos negativos hacia los migrantes. Si bien esta convergencia de odio puede no ser la más común, analizarla es esencial para comprender cómo los diferentes tipos de prejuicios se interconectan y amplifican entre sí en el espacio digital.

Para llevar a cabo este análisis interseccional, se emplearán detectores especializados, desarrollados y perfeccionados a través de múltiples proyectos, entre ellos COIN, ISADE, CeMIYA, y diversos estudios académicos y tesis doctorales. Estos detectores cubren temas clave como el antigitanismo, el antisemitismo, la islamofobia, la LGTBIfobia y la xenofobia. Su capacidad para identificar y categorizar formas complejas de odio permite un examen exhaustivo de cómo las actitudes discriminatorias se cruzan y se manifiestan en las plataformas sociales, sentando una base sólida para futuras intervenciones y políticas destinadas a combatir el odio en línea.

- Correlación entre toxicidad y odio

Hipótesis: La toxicidad lingüística en el discurso de odio es un indicador fiable de la gravedad de la hostilidad dirigida a grupos específicos, correspondiendo los niveles más altos de toxicidad a expresiones de odio más intensas.

Objetivo: Analizar la correlación entre el nivel de toxicidad de los mensajes y la gravedad del odio dirigido a diferentes colectivos y evaluar si determinados colectivos experimentan un lenguaje más tóxico en comparación con otros.

Esta hipótesis explora la relación entre la toxicidad del lenguaje y la intensidad del odio expresado, con el objetivo de evaluar la fiabilidad de la toxicidad como indicador de hostilidad severa hacia grupos específicos. El análisis busca descubrir las diferentes capas de agresión dentro del discurso de odio y examinar cómo estas dinámicas varían según los grupos objetivo. Esto proporcionará una comprensión más profunda de cómo los diferentes niveles de toxicidad se relacionan con diferentes manifestaciones de odio. Para lograr esto, se exploran los patrones de discurso de odio utilizando detectores de probabilidad 0-1, con una evaluación integral de la toxicidad realizada en todas las plataformas, empleando un umbral de detección de 0,7.

El objetivo principal de esta investigación es investigar la correlación entre la toxicidad lingüística y diversas formas de odio y evaluar si ciertos grupos están expuestos a niveles más altos de toxicidad que otros. Esto implica un análisis exhaustivo del lenguaje utilizado, centrándose en la prevalencia de insultos, amenazas, blasfemias y expresiones extremas de toxicidad dirigidas a diferentes grupos vulnerables.

Este marco teórico nos permite clasificar y cuantificar las expresiones explícitas de odio al tiempo que interpretamos las implicaciones subyacentes de las variaciones en la toxicidad del lenguaje. Al analizar estos patrones, obtenemos una visión más profunda de las dinámicas de discriminación y agresión en la comunicación en línea. Esto ofrece una base para intervenciones más efectivas y el desarrollo de políticas informadas para mitigar el impacto de las agresiones y los delitos de odio dentro de la sociedad española.

- Análisis de sentimientos

Hipótesis: El discurso de odio varía no solo en su nivel de toxicidad, sino también en su contenido emocional, y los diferentes grupos están sujetos a distintos tonos emocionales como la ira, el resentimiento o el miedo.

Objetivo: Examinar las dimensiones emocionales del discurso de odio utilizando herramientas de análisis de sentimientos para evaluar cómo varían los tonos emocionales entre los diferentes grupos, proporcionando información sobre el impacto psicológico de estos mensajes en línea.

Esta sección profundiza en el complejo panorama emocional del discurso de odio en línea a través de un análisis gradual del sentimiento en los mensajes dirigidos a varios grupos vulnerables. Mediante la aplicación de herramientas avanzadas de análisis de sentimientos, como SentiStrength, nuestro objetivo es evaluar cualitativamente la gama de emociones incrustadas en estos mensajes de odio. Esta exploración ayuda a identificar la hostilidad manifiesta y descubre los sentimientos subyacentes, que van desde la ira y el miedo hasta el resentimiento y el desdén, que alimentan el discurso en línea.

El estudio explorará cómo estas emociones se manifiestan de manera diferente en los grupos, revelando la intensidad emocional y los patrones de fluctuación. Por ejemplo, el discurso de odio dirigido a la comunidad LGBTI puede tener un tono emocional diferente en comparación con el odio dirigido a migrantes o minorías religiosas. Al examinar estas dimensiones emocionales, la investigación proporciona una comprensión más matizada de cómo el discurso de odio afecta el discurso comunitario y el bienestar individual. Este mapeo emocional ofrecerá información crítica sobre el impacto psicológico del discurso de odio, lo que refuerza la necesidad de intervenciones específicas que aborden no solo la presencia del odio, sino también las corrientes emocionales subyacentes más profundas que lo impulsan.

- Proporción de mensajes y comparación con los delitos denunciados

Hipótesis: La frecuencia del discurso de odio en las plataformas de redes sociales se correlaciona con los incidentes de delitos de odio en el mundo real, pero existen discrepancias debido a la falta de información sobre ciertos tipos de odio, como la islamofobia.

Objetivo: Comparar la proporción de mensajes de odio identificados en la investigación con la frecuencia de los delitos de odio denunciados para evaluar cómo el discurso en línea se alinea con las manifestaciones físicas del odio y evaluar la necesidad de revisar las categorías de delitos para reflejar las realidades del odio en línea.

Este apartado se centra en comparar la frecuencia de los mensajes de odio detectados en las plataformas de redes sociales con las estadísticas oficiales de delitos de odio reportadas por la ONDOD (https://oficinanacional-delitosdeodio.ses.mir.es/publico/ONDOD) en su informe anual sobre la evolución de los delitos de odio en España (https://www.interior.gob.es/opencms/export/sites/default/.galleries/galeria-de-prensa/documentos-y-multimedia/balances-e-informes/2023/Informe_evolucion_delitos_odio_Espana_2023.pdf). Al establecer paralelismos entre el discurso de odio en línea y los incidentes del mundo real, la investigación tiene como objetivo evaluar si los patrones y tendencias observados en los entornos digitales se correlacionan con los documentados en los informes oficiales sobre delitos. Esta comparación ayuda a proporcionar una imagen más completa de la relación entre la hostilidad en línea y sus consecuencias fuera de línea, ofreciendo información valiosa tanto para los científicos sociales como para los responsables políticos para comprender el contexto más amplio del odio en España.

A través de esta comparación, nuestro objetivo es determinar si las proporciones de discurso de odio identificadas en las redes sociales se alinean con la distribución de los delitos de odio denunciados oficialmente. En concreto, analizamos si la intensidad del odio dirigido a colectivos concretos, como la comunidad LGTBI, en comparación con los inmigrantes, se corresponde con la frecuencia de los delitos cometidos contra estos colectivos. Este análisis nos permite evaluar la validez de hipótesis que sugieren discrepancias entre la manifestación en línea del odio y su materialización en acciones del mundo real, ofreciendo una comprensión más profunda de la relación entre la hostilidad digital y el daño físico.

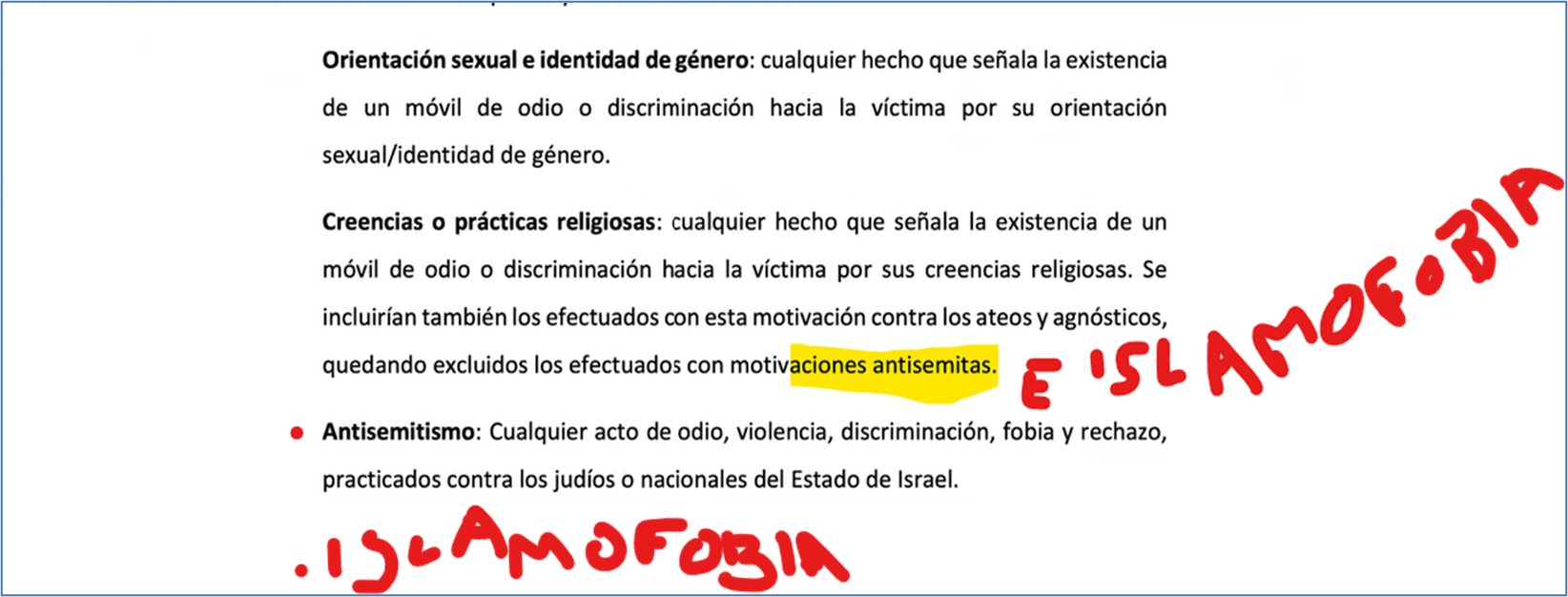

Para enero de 2025, se espera que se obtenga y analice el informe de incidentes de odio ONDOD 2024, lo que permitirá una comparación directa con los datos recopilados durante nuestro período de investigación de seis meses de abril a agosto. Este análisis incluirá la evaluación de diversas categorías de odio, como el antigitanismo, el antisemitismo, la orientación sexual y la identidad de género, y el racismo/xenofobia, que han sido identificadas tanto en el informe oficial como en nuestro estudio. Sin embargo, es esencial tener en cuenta las discrepancias en la clasificación, como la ausencia de una categoría específica de islamofobia en el informe oficial, que en su lugar la agrupa en categorías más amplias como «Creencias o prácticas religiosas».

El objetivo es determinar si las categorías que dominan los mensajes de odio en las redes sociales se alinean con aquellas que reportan las mayores incidencias de odio en contextos del mundo real. Por ejemplo, explora si la prevalencia de mensajes de odio relacionados con el racismo y la xenofobia es proporcional a la frecuencia de los delitos relacionados denunciados, ofreciendo información sobre la correlación entre las narrativas en línea y las acciones fuera de línea. Este enfoque mejora nuestra comprensión de las dinámicas del odio en la sociedad contemporánea para informar las intervenciones y las políticas públicas para reducir estas manifestaciones tanto en entornos digitales como físicos.

En este contexto, es necesaria una revisión y una posible actualización de las categorías utilizadas en el informe de la Oficina Nacional de Delitos de Odio (ONDOD), en particular en lo que respecta a la clasificación de los delitos relacionados con las prácticas religiosas. La inclusión actual del antisemitismo en una categoría genérica, sin reconocer explícitamente la islamofobia, parece insuficiente, dado el volumen y la especificidad de los incidentes islamófobos observados en nuestros datos. Teniendo en cuenta las tendencias recientes y la adición de nuevas categorías, como el antigitanismo promovido por la Fundación Secretariado Gitano [https://www.gitanos.org/centro_documentacion/herramientas/cajas/imagen_social.html.es], sostenemos que la islamofobia debe ser reconocida como una categoría distinta debido a su prevalencia y características únicas.

El proyecto COIN propone ejercer presión académica y estadística sobre la ONDOD para fomentar la revisión de su clasificación de delitos de odio. Como parte del compromiso de «Formulación de Políticas» descrito en sus Paquetes de Trabajo (WP), el proyecto preparará y presentará un informe detallado acompañado de una solicitud formal, subrayando la necesidad crítica de incluir la islamofobia como una categoría distinta en el informe anual sobre delitos de odio. Esta iniciativa tiene como objetivo garantizar un reflejo más preciso del panorama de los delitos de odio en la sociedad, apoyando así el desarrollo de políticas y estrategias de intervención más eficaces basadas en una comprensión integral de estos temas.

Orientación sexual e identidad de género: cualquier acto que indique la existencia de odio o discriminación hacia la víctima por su orientación sexual o identidad de género.

Creencias o prácticas religiosas: todo acto que indique la existencia de odio o discriminación hacia la víctima por sus creencias religiosas. Esto también incluirá acciones motivadas contra ateos y agnósticos, así como actos impulsados por motivaciones islamófobas o antisemitas.

- Antisemitismo: Cualquier acto de odio, violencia, discriminación, fobia o rechazo dirigido contra el pueblo judío o los nacionales del Estado de Israel.

- Islamofobia: Cualquier acto de odio, violencia, discriminación, fobia o rechazo dirigido contra musulmanes o individuos percibidos como pertenecientes a la religión islámica.

- Temas emergentes

Hipótesis: El discurso de odio a menudo está impulsado por temas de actualidad específicos que emergen del discurso social, y comprender estos temas es vital para abordar y mitigar la propagación del odio en línea.

Objetivo: Realizar un análisis inductivo para identificar y categorizar temas recurrentes en el discurso de odio y correlacionar estos temas con variables como el sentimiento y la toxicidad del lenguaje para comprender cómo temas particulares alimentan la propagación del odio en línea.

Esta sección utiliza un enfoque inductivo para descubrir y analizar temas recurrentes dentro del discurso de odio, con el objetivo de comprender los contextos y las dinámicas subyacentes que impulsan estas expresiones dañinas. El análisis categoriza las diversas formas de odio al tiempo que explora las narrativas más profundas que perpetúan estos sentimientos. A través de esta exploración temática, el estudio ofrece información valiosa sobre las causas fundamentales del odio y propone posibles soluciones para abordar su prevalencia en las plataformas de redes sociales.

El proceso inductivo permite descubrir temas emergentes relacionados con el odio contra varios grupos, concentrándose menos en las causas subyacentes, a menudo multifacéticas y complejas, y más en identificar los temas específicos que forman la base del discurso de odio. Esta identificación es vital, ya que el discurso de odio suele estar vinculado a temas de conversación o debate que dominan el discurso público.

Este análisis nos permite vincular temas emergentes con variables predefinidas como el SENTIMIENTO y la toxicidad del lenguaje, facilitando contrastes y análisis más matizados del discurso. Al correlacionar estos temas con los indicadores de toxicidad y tono emocional en los mensajes, profundizamos nuestra comprensión de cómo se intensifican y proliferan discursos específicos en las redes sociales. Esto proporciona una base sólida para elaborar intervenciones y estrategias de comunicación más eficaces para frenar la propagación del odio en línea.

Las cinco hipótesis propuestas se basan en un marco teórico sólido y tienen un potencial sustancial para avanzar en la comprensión científica en el estudio del discurso de odio. Además, se incluye un sexto componente en nuestro enfoque analítico:

- Elaboración de informes descriptivos generales

Estos informes son esenciales para documentar minuciosamente todos los aspectos de la investigación, proporcionando una comprensión integral en formatos académicos, materiales accesibles al público en general y publicaciones más extensas, como libros.

Hipótesis: Los informes descriptivos exhaustivos que combinan datos cualitativos y cuantitativos pueden ofrecer una comprensión más clara de los patrones y la dinámica del discurso de odio, lo que facilita intervenciones y políticas mejor informadas.

Objetivo: Preparar informes descriptivos detallados que documenten los hallazgos del análisis, proporcionando una base sólida para la investigación académica y la difusión pública y apoyando las recomendaciones de políticas basadas en evidencia para combatir el odio en línea.

En esta sexta fase del análisis, se realiza una evaluación cualitativa de una muestra seleccionada de mensajes de odio, ofreciendo una interpretación más profunda de los datos. Este análisis cualitativo complementa la descripción numérica más amplia, proporcionando información detallada sobre los patrones emergentes, los matices del lenguaje utilizado y las dinámicas subyacentes del odio. Este doble enfoque no solo fortalece la comprensión de los fenómenos estudiados, sino que también mejora la difusión del conocimiento a un público más amplio, facilitando la implementación de soluciones basadas en evidencia para combatir el discurso de odio en diversas plataformas sociales.

Monitoreo de contenido de odio, proceso y resultados de la herramienta automática de detección y seguimiento: segundo dato de contenido de odio

El proyecto COIN implementa un enfoque riguroso y profesional para recopilar y analizar el discurso de odio en las redes sociales, utilizando metodologías avanzadas para desentrañar y mapear interacciones complejas (INTERSECCIONALIDAD). Estos esfuerzos proporcionan información vital para el desarrollo de políticas y estrategias efectivas de intervención social.

Prácticamente, los datos recopilados por Max Frías y Will González de plataformas como Twitter (X), TikTok, Instagram y Facebook entre el 1 de abril y el 13 de agosto de 2024, se organizan y almacenan sistemáticamente en formato CCV. Para optimizar la gestión y el análisis de datos, se creó un sistema de almacenamiento estructurado en Google Drive, donde los archivos se organizan por redes sociales y meses. Este enfoque facilita el acceso y la revisión sistemática del contenido, con cada plataforma asignada a una carpeta específica que contiene todas las descargas relevantes. Este método mejora la eficiencia de la gestión de datos al tiempo que preserva la integridad y la trazabilidad de la información recopilada.

El proyecto COIN adopta un enfoque riguroso y profesional para recopilar y analizar diversas formas de discurso de odio en las redes sociales. Utiliza metodologías avanzadas para mapear y desentrañar interacciones complejas, incluidas las relacionadas con la interseccionalidad. Estos esfuerzos ofrecen información crucial para desarrollar políticas y estrategias efectivas de intervención social.

En la práctica, los datos recopilados por Max Frías y Will González de plataformas como Twitter (X), TikTok, Instagram y Facebook entre abril y agosto de 2024 se organizan y almacenan sistemáticamente en formato CSV. Para agilizar la gestión y el análisis de datos, creamos un sistema de almacenamiento en Google Drive, organizando los archivos por red social y mes, facilitando el fácil acceso y la revisión sistemática de los contenidos. Cada plataforma tiene su carpeta dedicada que contiene todas las descargas relevantes. Este método garantiza un manejo eficiente de los datos, al tiempo que mantiene la integridad y la trazabilidad de la información recopilada.

La recolección de datos concluyó el 13 de agosto de 2024. En ese momento, todos los datos se clasificaron cuidadosamente y se consolidaron en una base de datos unificada, registrando la relación de cada mensaje, la red social correspondiente y la fecha de publicación.

La estructura final de almacenamiento de datos está diseñada para mantener los registros separados por la red social, evitando la confusión o contaminación de datos entre plataformas, incluso cuando se almacenan en un solo archivo para su accesibilidad. Lo ideal es que se preparen cuatro archivos principales, cada uno correspondiente a una red social específica, lo que permite un análisis diferenciado y más detallado por plataforma.

Este meticuloso sistema de organización y documentación garantiza la eficiencia del proceso analítico y aumenta la fiabilidad de los resultados del estudio. Proporciona una base sólida para futuras publicaciones, investigaciones y aplicaciones prácticas en la lucha contra el discurso de odio en línea.

Objetivo General

Supervisa y analiza el contenido de odio dirigido a judíos, romaníes, migrantes, personas LGBTI y musulmanes en plataformas de redes sociales, como Twitter, Facebook, Instagram y TikTok.

Metodología y Procesamiento de Datos

La metodología involucra el uso de algoritmos avanzados, denominados «detectores», para identificar y categorizar el contenido de odio en los datos recopilados. Este proceso se apoya en una combinación de técnicas manuales y automatizadas para asegurar una cobertura exhaustiva y precisa de los tipos de odio presentes en las interacciones online (interseccionalidad).

Responsabilidades del equipo

- William González: Responsable de la extracción de datos a través de la API de TikTok y del análisis de contenidos en Instagram y Facebook utilizando la herramienta CrownTangle, supervisando el seguimiento y la evaluación de los contenidos de odio en estas plataformas.

- Max Frías: Responsable de coordinar la recopilación de datos en Twitter utilizando la API del Portal de Desarrolladores X, brindando soporte técnico para Instagram y Facebook, y contribuyendo activamente al análisis de contenido.

Recogida de datos

De abril a agosto de 2024 se llevó a cabo una recopilación sistemática de mensajes en redes sociales, centrándose en los contenidos que circulan en España y que están escritos en español. Este esfuerzo tuvo como objetivo capturar una amplia gama de temas y aplicar filtros de idioma y país para garantizar la relevancia regional y cultural de los datos. Se utilizaron herramientas como CrowdTangle para Facebook e Instagram, Developer Portal para X (Twitter) y la API de TikTok para optimizar la captura de datos, en particular para mejorar la extracción de contenido en Instagram.

Este proceso tuvo como objetivo compilar un amplio corpus de mensajes de redes sociales utilizando un método de muestreo aleatorio, orientando las publicaciones en español y originarias de España siempre que fuera posible.

- 610373 mensajes [Twitter (X): 42875; TikTok: 86372; Facebook: 409687; Instagram: 71439]

El proceso de recolección implica extracciones aleatorias diarias o semanales de estas plataformas. Se asignó personal específico para manejar estas herramientas: William y Max Frías se encargaron de utilizar CrowdTangle para recopilar datos de Instagram y Facebook. Al mismo tiempo, también coordinaron la extracción de datos de Twitter a través del Portal de Desarrolladores. Además, William González lideró la integración de la API de TikTok para capturar contenido relevante de Instagram. Dada la falta de un filtro de idioma en TikTok, se implementó un detector adicional para excluir el contenido que no sea español. Los datos recopilados se organizaron sistemáticamente y se entregaron en formato de archivo de texto (txt), con la compilación final el 13 de agosto de 2024.

X (Twitter)

La recolección de muestras se realizó del 1 de abril al 13 de agosto de 2024, desde la red social X a través de la API de su plataforma. Se trató de una recopilación sistemática de mensajes centrados en los contenidos que circulaban en español.

Finalmente, solo tres días de la muestra estratificada no se descargaron: 1 y 3 de abril y 8 de mayo, debido a problemas técnicos con la plataforma de descarga. Además, un día, el 13 de agosto, no se pudo realizar la descarga de mensajes de tendencia por las mismas razones. En total, se obtuvo una muestra final de n = 42.875 mensajes.

Objetivo:

Compilar un corpus amplio de X (Twitter) mensajes de redes sociales publicados en español y español utilizando un método de muestreo aleatorio estratificado.

Metodología:

- Selección de contenido:

- Se centra en los mensajes que circulan dentro de España y están escritos en español.

- Incluir contenido de aplicación de filtros de idioma y país para garantizar la relevancia regional y cultural de los datos.

- Consulta: «migrante», «migrantes», «migración», «refugiada», «refugiadas», «refugiado», «refugiados», «musulmán», «musulmanes», «musulmanas», «árabes», «árabes», «moro», «moros», «islamista», «islamista», «islamistas», «islamismo», «gitano», «gitanos», «gitana», «gitanas», «judío», «judíos», «sionista», «sionistas», «semita», «semitas», «judaísmo», «semitismo», «gay», «gays», «lesbianas», «lesbianas», «transexual», «transexuales», «lgtb», «lgbti», «lgtbi+», «lgtbiq»

- Criterios de filtrado:

- Idioma: Español.

- País: España.

- Periodo: del 1 de abril al 13 de agosto de 2024.

- Recogida de datos:

- Diariamente se descargaron un total de 333 mensajes, de los cuales 100 correspondieron a los mensajes más relevantes del día, y los 233 restantes se recogieron a través de una muestra sistemática estratificada a lo largo de dos horas diarias. Para ello, se seleccionaron bloques de dos horas desde las 8:00 a.m. hasta las 10:00 p.m., comenzando el 1 de octubre de 8:00 a 10:00 a.m., continuando el 2 de octubre de 10:00 a 12:00 p.m., y así sucesivamente hasta el 7 de octubre cuando la recolección ocurrió de 8:00 a 10:00 p.m., luego reiniciando el 8 de octubre de 8:00 a 10:00 a.m.

- Utilice las siguientes herramientas y asignaciones de personal:

- Portal del desarrollador: La red social X API optimizó la captura de datos.

- Nota: Los filtros de país y de idioma están disponibles para Twitter, y un detector adicional excluirá el contenido que no sea en español.

- Formato de entrega de datos:

- El archivo de texto (.txt) se entregará a finales de junio de 2024.

Facebook (en inglés)

La recolección de muestras de Facebook se llevó a cabo entre el 1 de abril y el 13 de agosto de 2024, centrándose principalmente en grupos públicos considerados más adecuados para estudiar el discurso de odio que las páginas de fans. Este enfoque se eligió en función de varias características clave de los grupos públicos:

- Autenticidad y moderación reducida: Los usuarios del grupo tienden a expresar opiniones más extremas o controvertidas que las de las páginas de fans, que a menudo están vinculadas a marcas o figuras públicas y, por lo tanto, sujetas a una moderación más estricta.

- Cámaras de eco: Los grupos públicos, especialmente los privados, a menudo reúnen a personas con puntos de vista similares, creando entornos en los que el discurso de odio puede amplificarse con un mínimo de supervisión o moderación.

- Mayor interacción con el usuario: Los grupos permiten a los usuarios crear publicaciones y participar en discusiones de manera más activa que las páginas, lo que genera intercambios dinámicos y potencialmente hostiles.

- Menor supervisión institucional: mientras que las páginas administradas por instituciones o figuras públicas se someten a una moderación más rigurosa, los grupos administrados por usuarios suelen tener una supervisión menos estricta, lo que permite que el discurso de odio se propague más libremente.

Objetivo:

Compilar un corpus amplio de mensajes de Facebook publicados en español y español utilizando un método de muestreo sistemático, centrándose en las interacciones de grupos públicos donde es más probable que surjan discursos de odio.

Metodología:

- Selección de contenido:

- Centrarse en las publicaciones de grupos públicos que circulan dentro de España y están escritas en español.

- Prioriza las publicaciones que contengan discursos de odio hacia grupos vulnerables como migrantes, musulmanes, judíos, la comunidad LGBTI y romaníes.

- Consultas: «migrante», «migrantes», «migración», «refugiada», «refugiadas», «refugiado», «refugiados», «musulmán», «musulmanes», «musulmanas», «árabes», «árabes», «moro», «moros», «islam», «islamista», «islamista», «islamistas», «islamismo», «gitano», «gitanos», «gitana», «gitanas», «judío», «judíos», «sionista», «sionistas», «semita», «semitas», «judaísmo», «semitismo», «gay», «gays», «lesbianas», «lesbianas», «transexual», «transexuales», «lgtb», «lgbti», «lgtbi+», «lgtbiq».

- Criterios de filtrado:

- Idioma: Español.

- País: España.

- Periodo: del 1 de abril al 13 de agosto de 2024.

- Recogida de datos:

- Los datos recopilados consistieron en varios formatos, incluidas fotos, videos, enlaces y actualizaciones de estado.

- Se realizaron extracciones aleatorias diarias o semanales utilizando CrowdTangle, diseñado explícitamente para monitorear contenido en Facebook.

- Personal responsable de las operaciones de CrowdTangle: William González.

- Nota: Se aplicaron filtros de idioma para garantizar que el contenido se capturara en español, y se aplicó un filtro adicional para excluir el contenido irrelevante.

- Limpieza de datos:

- Después del proceso de recopilación, se eliminaron todas las publicaciones duplicadas o irrelevantes, como las que no tenían información textual (por ejemplo, las publicaciones que solo contenían emoticonos o enlaces).

- Muestra final:

- Después de la limpieza, se obtuvo un conjunto de datos final de 409.687 mensajes, que representan el período de estudio.

Formato de entrega de datos:

- El conjunto de datos final se entregó como un archivo de texto (.txt) y se preparó para su análisis a finales de agosto de 2024.

Instragram

La recopilación de datos de Instagram se llevó a cabo entre el 1 de abril y el 13 de agosto de 2024, centrándose en tipos de contenido como publicaciones de fotos, carruseles y videos. El objetivo era capturar un amplio espectro de interacciones de los usuarios en las que pudiera aparecer el discurso de odio, como Facebook, pero adaptado a la plataforma multimedia de Instagram.

Objetivo:

Recopilar un amplio corpus de publicaciones de Instagram en español, centrándose en los contenidos visuales (fotos, carruseles y vídeos) que circulan en España, utilizando un método de muestreo sistemático.

Metodología:

- Selección de contenido:

- Céntrate en las publicaciones de Instagram compartidas dentro de España y escritas en español.

- Prioriza las publicaciones que puedan contener discursos de odio dirigidos a grupos como migrantes, musulmanes, judíos, personas LGBTI y romaníes.

- Consultas: «migrante», «migrantes», «migración», «refugiada», «refugiadas», «refugiado», «refugiados», «musulmán», «musulmanes», «musulmanas», «árabes», «árabes», «moro», «moros», «islam», «islamista», «islamista», «islamistas», «islamismo», «gitano», «gitanos», «gitana», «gitanas», «judío», «judíos», «sionista», «sionistas», «semita», «semitas», «judaísmo», «semitismo», «gay», «gays», «lesbianas», «lesbianas», «transexual», «transexuales», «lgtb», «lgbti», «lgtbi+», «lgtbiq».

- Criterios de filtrado:

- Idioma: Español.

- País: España (cuando sea posible).

- Periodo: del 1 de abril al 13 de agosto de 2024.

- Recogida de datos:

- La recopilación de datos se centró en imágenes, carruseles y vídeos extraídos sistemáticamente con CrowdTangle, optimizados para el seguimiento de las publicaciones de Instagram.

- Se realizaron extracciones diarias y semanales, asegurando la pertinencia del contenido a los objetivos del estudio.

- Personal responsable de la recopilación de datos de Instagram a través de CrowdTangle: William y Max.

- Nota: Se aplicaron filtros de idioma para capturar solo contenido en español y se aplicaron filtros de país cuando fue posible.

- Limpieza de datos:

- Los datos recopilados se limpiaron eliminando las publicaciones duplicadas y las entradas irrelevantes, como las que no tienen ningún contexto textual (por ejemplo, publicaciones que contienen solo emojis o enlaces).

- Muestra final:

- Después de la limpieza y el filtrado, el conjunto de datos final comprendió 71,439 registros que representan el contenido de Instagram recopilado durante el período de estudio.

Formato de entrega de datos:

- El conjunto de datos final se entregó como un archivo de texto (.txt) y se preparó para su análisis a finales de agosto de 2024.

TikTok

La recopilación de datos de TikTok enfrentó desafíos técnicos, específicamente la recuperación de videos y comentarios asociados a través de la API de la plataforma. A pesar de estos obstáculos, se recopiló una parte significativa de los datos, centrándose en el contenido en español durante el período designado. La recolección se llevó a cabo entre el 1 y el 30 de abril de 2024, utilizando un cuaderno de Jupyter personalizado para aplicar filtros de idioma.

Objetivo:

Reunir un amplio corpus de videos de TikTok y sus descripciones en español, capturando discursos de odio dirigidos a grupos vulnerables como migrantes, musulmanes, judíos, personas LGBTI y personas gitanas.

Metodología:

- Selección de contenido:

- Enfócate en los videos y descripciones de TikTok que circulan en España y están escritos en español.

- Prioriza el contenido con potencial discurso de odio contra grupos como migrantes, musulmanes, judíos, personas LGBTI y romaníes.

- Consultas: «migrante», «musulmán», «judío», «lgtbiq», «gitano», etc.

- Criterios de filtrado:

- Idioma: Español.

- País: España (cuando sea posible).

- Periodo: del 1 de abril al 30 de abril de 2024.

- Recogida de datos:

- La recolección de datos se llevó a cabo utilizando un cuaderno Jupyter, con un filtro de idioma aplicado para recuperar descripciones de videos de TikTok en español.

- La recolección se realizó diariamente desde el 1 de abril hasta el 30 de abril de 2024. Sin embargo, después del 30 de abril, las solicitudes de datos fallaron, probablemente debido a actualizaciones internas dentro de la API de investigación de TikTok.

- Personal responsable de la recopilación de datos de TikTok: William.

- Nota: Se aplicó un filtro de idioma para excluir el contenido que no fuera español, mientras que los filtros de país no estaban disponibles.

- Desafíos de los datos:

- Después del 30 de abril, las solicitudes de datos de TikTok comenzaron a fallar debido a posibles actualizaciones internas de la API, aunque no se proporcionaron comunicaciones oficiales ni actualizaciones de documentación a los usuarios de la API.

- Limpieza de datos:

- Los datos recopilados se limpiaron eliminando el contenido duplicado y las entradas sin texto significativo, como las que solo tienen emojis o campos vacíos.

- Muestra final:

-

- Después de la limpieza y el filtrado, el conjunto de datos final constó de 86.372 mensajes de TikTok recopilados entre el 1 y el 30 de abril.

Formato de entrega de datos:

- El conjunto de datos final, incluidas las descripciones de los vídeos de TikTok, se entregó como un archivo de texto (.txt) a finales de abril de 2024, que contenía todas las entradas válidas recogidas durante el mes de abril.

Análisis de datos

El análisis se centrará en identificar las interacciones en las que convergen diferentes formas de odio, utilizando una metodología interseccional para descubrir patrones complejos en el discurso de odio. Se analizarán diecisiete categorías (o variables), incluyendo referencias directas a colectivos concretos como judíos, gitanos, musulmanes, LGTBI e inmigrantes. Además, se examinarán las variables latentes para detectar la presencia de odio, toxicidad y tono emocional en los mensajes utilizando herramientas como Perspective API y SentiStrength.

Entregables y cronograma:

- Entre abril y agosto de 2024: Finalización de la recopilación del corpus de mensajes, que luego se filtrará y se preparará para su posterior análisis.

- 13 de agosto de 2024: Conclusión de la recopilación de datos y elaboración de informes preliminares.

- 30 de septiembre de 2024: Presentación de los expedientes del corpus e informes preliminares (D5.2).

- Octubre de 2024: Se organizará un hackathon para el análisis detallado de los datos, que culminará con la presentación final de los informes D5.2 y D5.3 y una evaluación del progreso del WP5.

Hitos clave:

- Para el 13 de agosto de 2024:

- Un corpus de mensajes en español de las redes sociales (Twitter, Facebook, TikTok e Instagram) en España (archivo .txt):

- Debe representar el período de abril a agosto de 2024.

- Incluye mensajes filtrados por idioma y país (cuando sea posible), preparados para su posterior análisis.

- Un corpus de mensajes en español de las redes sociales (Twitter, Facebook, TikTok e Instagram) en España (archivo .txt):

- Durante el proceso:

- Informes periódicos de progreso:

- Hará un seguimiento de la progresión del corpus y de los resultados preliminares del análisis de contenido.

- Debe reflejar los desafíos encontrados y las soluciones implementadas.

- Informes periódicos de progreso:

- Al final del período de recopilación y análisis de datos:

- Informe D5.2:

- Documenta los métodos y resultados del monitoreo de contenido de odio dirigido a varios grupos vulnerables en las redes sociales.

- Incluye estadísticas y ejemplos representativos de contenido de odio detectado.

- Informe D5.3:

- Proporciona un mapeo detallado de las formas de incitación al odio en línea.

- Analiza y discute la interseccionalidad en los discursos de odio identificados.

- Incluye visualizaciones gráficas para ilustrar las interconexiones y la prevalencia de diferentes formas de odio.

- Informe D5.2:

Línea de tiempo:

- Abril-Agosto 2024:

- Recopilación y filtrado de datos.

- Desarrollo y puesta a punto de detectores.

- Septiembre 2024:

- Análisis preliminar del corpus.

- Ajustes a la metodología si es necesario.

- Elaboración del Informe D5.2.

- Octubre 2024:

- Finalización de la recopilación de datos.

- Presentación del informe D5.2.

- Noviembre 2024:

- Desarrollo de mapas de discursos de odio y análisis de interseccionalidad.

- Elaboración y revisión del Informe D5.3.

- Diciembre 2024:

- Finalización y presentación de informes D5.3.

- Evaluación del WP5 y propuestas para futuras direcciones de investigación (y publicación).

Criterios de éxito y medidas de contingencia

El éxito del Paquete de Trabajo 5 del proyecto COIN se evalúa en base a criterios interrelacionados que aseguran la integridad y pertinencia de la investigación. Un elemento clave es la integridad del corpus, que garantiza que todos los datos necesarios se recopilen de acuerdo con los estándares metodológicos establecidos, asegurando un conjunto de datos completo y representativo. Esto es esencial para la validez de las conclusiones del estudio. Al mismo tiempo, la calidad del análisis desempeña un papel fundamental, ya que la profundidad y la precisión con la que se identifica y categoriza el contenido de odio afecta directamente a la solidez de los hallazgos. Este análisis detallado es crucial para descubrir los matices y complejidades del discurso de odio en línea dirigido a grupos vulnerables.

Además, el éxito del proyecto COIN se basa en la comunicación efectiva de sus resultados. Las visualizaciones de datos sencillas y bien diseñadas son vitales, ya que permiten a las partes interesadas captar información compleja de forma rápida y precisa, lo que facilita la toma de decisiones informadas basadas en los resultados proporcionados.

En previsión de posibles desafíos, el proyecto ha desarrollado medidas de contingencia para mantener la continuidad y la calidad de su trabajo. En el caso de retrasos en la recopilación de datos o dificultades para acceder a los datos, ya sea debido a altos costos económicos o al cierre parcial o total del acceso, las sesiones adicionales de recopilación de datos son un recurso crucial para recuperar el tiempo perdido y garantizar un volumen de datos suficiente para un análisis exhaustivo. Además, la dependencia del proyecto de API externas presenta una vulnerabilidad a los cambios en su disponibilidad. La adaptación a través de herramientas alternativas o soluciones de software personalizadas garantiza que el proyecto continúe con una interrupción mínima.

Segundo análisis de datos de contenido de odio

El proyecto COIN implementa un enfoque riguroso y profesional para recopilar y analizar el discurso de odio en las redes sociales, utilizando metodologías avanzadas para desentrañar y mapear interacciones complejas (INTERSECCIONALIDAD). Estos esfuerzos proporcionan información vital para el desarrollo de políticas y estrategias efectivas de intervención social.

Prácticamente, los datos recopilados por Max Frías y Will González de plataformas como Twitter (X), TikTok, Instagram y Facebook entre el 1 de abril y el 13 de agosto de 2024, se organizan y almacenan sistemáticamente en formato CCV. Para optimizar la gestión y el análisis de datos, se creó un sistema de almacenamiento estructurado en Google Drive, donde los archivos se organizan por redes sociales y meses. Este enfoque facilita el acceso y la revisión sistemática del contenido, con cada plataforma asignada a una carpeta específica que contiene todas las descargas relevantes. Este método mejora la eficiencia de la gestión de datos al tiempo que preserva la integridad y la trazabilidad de la información recopilada.

El proyecto COIN adopta un enfoque riguroso y profesional para recopilar y analizar diversas formas de discurso de odio en las redes sociales. Utiliza metodologías avanzadas para mapear y desentrañar interacciones complejas, incluidas las relacionadas con la interseccionalidad. Estos esfuerzos ofrecen información crucial para desarrollar políticas y estrategias efectivas de intervención social.

En la práctica, los datos recopilados por Max Frías y Will González de plataformas como Twitter (X), TikTok, Instagram y Facebook entre abril y agosto de 2024 se organizan y almacenan sistemáticamente en formato CSV. Para agilizar la gestión y el análisis de datos, creamos un sistema de almacenamiento en Google Drive, organizando los archivos por red social y mes, facilitando el fácil acceso y la revisión sistemática de los contenidos. Cada plataforma tiene su carpeta dedicada que contiene todas las descargas relevantes. Este método garantiza un manejo eficiente de los datos, al tiempo que mantiene la integridad y la trazabilidad de la información recopilada.

La recolección de datos concluyó el 13 de agosto de 2024. En ese momento, todos los datos se clasificaron cuidadosamente y se consolidaron en una base de datos unificada, registrando la relación de cada mensaje, la red social correspondiente y la fecha de publicación.

La estructura final de almacenamiento de datos está diseñada para mantener los registros separados por la red social, evitando la confusión o contaminación de datos entre plataformas, incluso cuando se almacenan en un solo archivo para su accesibilidad. Lo ideal es que se preparen cuatro archivos principales, cada uno correspondiente a una red social específica, lo que permite un análisis diferenciado y más detallado por plataforma.

Este meticuloso sistema de organización y documentación garantiza la eficiencia del proceso analítico y aumenta la fiabilidad de los resultados del estudio. Proporciona una base sólida para futuras publicaciones, investigaciones y aplicaciones prácticas en la lucha contra el discurso de odio en línea.

Objetivo General

Supervisa y analiza el contenido de odio dirigido a judíos, romaníes, migrantes, personas LGBTI y musulmanes en plataformas de redes sociales, como Twitter, Facebook, Instagram y TikTok.

Metodología y Procesamiento de Datos

La metodología involucra el uso de algoritmos avanzados, denominados «detectores», para identificar y categorizar el contenido de odio en los datos recopilados. Este proceso se apoya en una combinación de técnicas manuales y automatizadas para asegurar una cobertura exhaustiva y precisa de los tipos de odio presentes en las interacciones online (interseccionalidad).

Responsabilidades del equipo

- William González: Responsable de la extracción de datos a través de la API de TikTok y del análisis de contenidos en Instagram y Facebook utilizando la herramienta CrownTangle, supervisando el seguimiento y la evaluación de los contenidos de odio en estas plataformas.

- Maximiliano Frías: Responsable de coordinar la recopilación de datos en Twitter utilizando la API del Portal de Desarrolladores X, brindando soporte técnico para Instagram y Facebook, y contribuyendo activamente al análisis de contenido.

Recogida de datos

De abril a agosto de 2024 se llevó a cabo una recopilación sistemática de mensajes en redes sociales, centrándose en los contenidos que circulan en España y que están escritos en español. Este esfuerzo tuvo como objetivo capturar una amplia gama de temas y aplicar filtros de idioma y país para garantizar la relevancia regional y cultural de los datos. Para optimizar la captura de datos, se utilizaron herramientas como CrowdTangle para Facebook e Instagram, el Portal de Desarrolladores para X (Twitter) y la API de TikTok, que mejoran especialmente la extracción de contenido en Instagram.

Este proceso tuvo como objetivo compilar un amplio corpus de mensajes de redes sociales utilizando un método de muestreo aleatorio, orientando las publicaciones en español y originarias de España siempre que fuera posible.

- 610373 mensajes [Twitter (X): 42875; TikTok: 86372; Facebook: 409687; Instagram: 71439]

El proceso de recolección implica extracciones aleatorias diarias o semanales de estas plataformas. Se asignó personal específico para manejar estas herramientas: William González y Max Frías se encargaron de utilizar CrowdTangle para recopilar datos de Instagram y Facebook. Al mismo tiempo, también coordinaron la extracción de datos de Twitter a través del Portal de Desarrolladores. Además, William González lideró la integración de la API de TikTok para capturar contenido relevante de Instagram. Dada la falta de un filtro de idioma en TikTok, se implementó un detector adicional para excluir el contenido que no sea español. Los datos recopilados se organizaron sistemáticamente y se entregaron en formato de archivo de texto (txt), con la compilación final el 13 de agosto de 2024.

X (Twitter)

La recolección de muestras se realizó del 1 de abril al 13 de agosto de 2024, desde la red social X a través de la API de su plataforma. Se trató de una recopilación sistemática de mensajes centrados en los contenidos que circulaban en español.

Finalmente, solo tres días de la muestra estratificada no se descargaron: 1 y 3 de abril y 8 de mayo, debido a problemas técnicos con la plataforma de descarga. Además, un día, el 13 de agosto, no se pudo realizar la descarga de mensajes de tendencia por las mismas razones. En total, se obtuvo una muestra final de n = 42.875 mensajes.

Objetivo:

Compilar un corpus amplio de X (Twitter) mensajes de redes sociales publicados en español y español utilizando un método de muestreo aleatorio estratificado.

Metodología:

- Selección de contenido:

- Se centra en los mensajes que circulan dentro de España y están escritos en español.

- Incluir contenido de aplicación de filtros de idioma y país para garantizar la relevancia regional y cultural de los datos.

- Consulta: «migrante», «migrantes», «migración», «refugiada», «refugiadas», «refugiado», «refugiados», «musulmán», «musulmanes», «musulmanas», «árabes», «árabes», «moro», «moros», «islamista», «islamista», «islamistas», «islamismo», «gitano», «gitanos», «gitana», «gitanas», «judío», «judíos», «sionista», «sionistas», «semita», «semitas», «judaísmo», «semitismo», «gay», «gays», «lesbianas», «lesbianas», «transexual», «transexuales», «lgtb», «lgbti», «lgtbi+», «lgtbiq»

- Criterios de filtrado:

- Idioma: Español.

- País: España.

- Periodo: del 1 de abril al 13 de agosto de 2024.

- Recogida de datos:

- Diariamente se descargaron un total de 333 mensajes, de los cuales 100 correspondieron a los mensajes más relevantes del día, y los 233 restantes se recogieron a través de una muestra sistemática estratificada a lo largo de dos horas diarias. Para ello, se seleccionaron bloques de dos horas desde las 8:00 a.m. hasta las 10:00 p.m., comenzando el 1 de octubre de 8:00 a 10:00 a.m., continuando el 2 de octubre de 10:00 a 12:00 p.m., y así sucesivamente hasta el 7 de octubre cuando la recolección ocurrió de 8:00 a 10:00 p.m., luego reiniciando el 8 de octubre de 8:00 a 10:00 a.m.

- Utilice las siguientes herramientas y asignaciones de personal:

- Portal del desarrollador: La red social X API optimizó la captura de datos.

-

- Personal responsable de la recolección de datos X: Maximiliano Frías.

-

- Nota: Los filtros de país y de idioma están disponibles para Twitter, y un detector adicional excluirá el contenido que no sea en español.

- Formato de entrega de datos:

- Archivo de texto (.txt) que se entregará a finales de agosto de 2024.

Facebook (en inglés)

La recolección de muestras de Facebook se llevó a cabo entre el 1 de abril y el 13 de agosto de 2024, centrándose principalmente en grupos públicos considerados más adecuados para estudiar el discurso de odio que las páginas de fans. Este enfoque se eligió en función de varias características clave de los grupos públicos:

- Autenticidad y moderación reducida: Los usuarios del grupo tienden a expresar opiniones más extremas o controvertidas que las de las páginas de fans, que a menudo están vinculadas a marcas o figuras públicas y, por lo tanto, sujetas a una moderación más estricta.

- Cámaras de eco: Los grupos públicos, especialmente los privados, a menudo reúnen a personas con puntos de vista similares, creando entornos en los que el discurso de odio puede amplificarse con un mínimo de supervisión o moderación.

- Mayor interacción con el usuario: Los grupos permiten a los usuarios crear publicaciones y participar en discusiones de manera más activa que las páginas, lo que genera intercambios dinámicos y potencialmente hostiles.

- Menor supervisión institucional: mientras que las páginas administradas por instituciones o figuras públicas se someten a una moderación más rigurosa, los grupos administrados por usuarios suelen tener una supervisión menos estricta, lo que permite que el discurso de odio se propague más libremente.

Objetivo:

Compilar un corpus amplio de mensajes de Facebook publicados en español y español utilizando un método de muestreo sistemático, centrándose en las interacciones de grupos públicos donde es más probable que surjan discursos de odio.

Metodología:

- Selección de contenido:

- Centrarse en las publicaciones de grupos públicos que circulan dentro de España y están escritas en español.

- Prioriza las publicaciones que contengan discursos de odio hacia grupos vulnerables como migrantes, musulmanes, judíos, la comunidad LGBTI y romaníes.

- Consultas: «migrante», «migrantes», «migración», «refugiada», «refugiadas», «refugiado», «refugiados», «musulmán», «musulmanes», «musulmanas», «árabes», «árabes», «moro», «moros», «islam», «islamista», «islamista», «islamistas», «islamismo», «gitano», «gitanos», «gitana», «gitanas», «judío», «judíos», «sionista», «sionistas», «semita», «semitas», «judaísmo», «semitismo», «gay», «gays», «lesbianas», «lesbianas», «transexual», «transexuales», «lgtb», «lgbti», «lgtbi+», «lgtbiq».

- Criterios de filtrado:

- Idioma: Español.

- País: España.

- Periodo: del 1 de abril al 13 de agosto de 2024.

- Recopilación de datos:

- Los datos recopilados consistieron en varios formatos, incluidas fotos, videos, enlaces y actualizaciones de estado.

- Se realizaron extracciones aleatorias diarias o semanales utilizando CrowdTangle, diseñado explícitamente para monitorear contenido en Facebook.

- Personal responsable de las operaciones de CrowdTangle: William González.

- Nota: Se aplicaron filtros de idioma para garantizar que el contenido se capturara en español, y se aplicó un filtro adicional para excluir el contenido irrelevante.

- Limpieza de datos:

- Después del proceso de recopilación, se eliminaron todas las publicaciones duplicadas o irrelevantes, como las que no tenían información textual (por ejemplo, las publicaciones que solo contenían emoticonos o enlaces).

- Muestra final:

- Después de la limpieza, se obtuvo un conjunto de datos final de 409.687 mensajes, que representan el período de estudio.

Formato de entrega de datos:

- El conjunto de datos final se entregó como un archivo de texto (.txt) y se preparó para su análisis a finales de agosto de 2024.

Instragram

La recopilación de datos de Instagram se llevó a cabo entre el 1 de abril y el 13 de agosto de 2024, centrándose en tipos de contenido como publicaciones de fotos, carruseles y videos. El objetivo era capturar un amplio espectro de interacciones de los usuarios en las que pudiera aparecer el discurso de odio, como Facebook, pero adaptado a la plataforma multimedia de Instagram.

Objetivo:

Recopilar un amplio corpus de publicaciones de Instagram en español, centrándose en los contenidos visuales (fotos, carruseles y vídeos) que circulan en España, utilizando un método de muestreo sistemático.

Metodología:

- Selección de contenido:

- Céntrate en las publicaciones de Instagram compartidas dentro de España y escritas en español.

- Prioriza las publicaciones que puedan contener discursos de odio dirigidos a grupos como migrantes, musulmanes, judíos, personas LGBTI y romaníes.

- Consultas: «migrante», «migrantes», «migración», «refugiada», «refugiadas», «refugiado», «refugiados», «musulmán», «musulmanes», «musulmanas», «árabes», «árabes», «moro», «moros», «islam», «islamista», «islamista», «islamistas», «islamismo», «gitano», «gitanos», «gitana», «gitanas», «judío», «judíos», «sionista», «sionistas», «semita», «semitas», «judaísmo», «semitismo», «gay», «gays», «lesbianas», «lesbianas», «transexual», «transexuales», «lgtb», «lgbti», «lgtbi+», «lgtbiq».

- Criterios de filtrado:

- Idioma: Español.

- País: España (cuando sea posible).

- Periodo: del 1 de abril al 13 de agosto de 2024.

- Recopilación de datos:

- La recopilación de datos se centró en imágenes, carruseles y vídeos extraídos sistemáticamente con CrowdTangle, optimizados para el seguimiento de las publicaciones de Instagram.

- Se realizaron extracciones diarias y semanales, asegurando la pertinencia del contenido a los objetivos del estudio.

- Personal responsable de la recogida de datos de Instagram a través de CrowdTangle: William González y Max Frías.

- Nota: Se aplicaron filtros de idioma para capturar solo contenido en español y se utilizaron filtros de país cuando fue posible.

- Limpieza de datos:

- Los datos recopilados se limpiaron eliminando las publicaciones duplicadas y las entradas irrelevantes, como las que no tienen ningún contexto textual (por ejemplo, publicaciones que contienen solo emojis o enlaces).

- Muestra final:

- Después de la limpieza y el filtrado, el conjunto de datos final comprendió 71,439 registros que representan el contenido de Instagram recopilado durante el período de estudio.

Formato de entrega de datos:

- El conjunto de datos final se entregó como un archivo de texto (.txt) y se preparó para su análisis a finales de agosto de 2024.

TikTok

La recopilación de datos de TikTok enfrentó desafíos técnicos, específicamente la recuperación de videos y comentarios asociados a través de la API de la plataforma. A pesar de estos obstáculos, se recopiló una parte significativa de los datos, centrándose en el contenido en español durante el período designado. La recolección se llevó a cabo entre el 1 y el 30 de abril de 2024, utilizando un cuaderno de Jupyter personalizado para aplicar filtros de idioma.

Objetivo:

Reunir un amplio corpus de videos de TikTok y sus descripciones en español, capturando discursos de odio dirigidos a grupos vulnerables como migrantes, musulmanes, judíos, personas LGBTI y personas gitanas.

Metodología:

- Selección de contenido:

- Enfócate en los videos y descripciones de TikTok que circulan en España y están escritos en español.

- Prioriza el contenido con potencial discurso de odio contra grupos como migrantes, musulmanes, judíos, personas LGBTI y romaníes.

- Consultas: «migrante», «migrantes», «migración», «refugiada», «refugiadas», «refugiado», «refugiados», «musulmán», «musulmanes», «musulmanas», «árabes», «árabes», «moro», «moros», «islam», «islamista», «islamistas», «islamismo», «gitano», «gitanos», «gitana», «gitanas», «judío», «judíos», «sionista», «sionistas», «semita», «semitas», «judaísmo», «semitismo», «gay», «gays», «lesbianas», «lesbianas», «transexual», «transexuales», «lgtb», «lgbti», «lgtbi+», «lgtbiq»migrante», » musulmán», «judío», «lgtbiq».

- Criterios de filtrado:

- Idioma: Español.

- País: España (cuando sea posible).

- Periodo: del 1 de abril al 30 de abril de 2024.

- Recopilación de datos:

- La recolección de datos se llevó a cabo utilizando un cuaderno Jupyter, con un filtro de idioma aplicado para recuperar descripciones de videos de TikTok en español.

- La recolección se realizó diariamente desde el 1 de abril hasta el 30 de abril de 2024. Sin embargo, después del 30 de abril, las solicitudes de datos fallaron, probablemente debido a actualizaciones internas dentro de la API de investigación de TikTok.

- Personal responsable de la recopilación de datos en TikTok: William González.

- Nota: Se aplicó un filtro de idioma para excluir el contenido que no fuera español, mientras que los filtros de país no estaban disponibles.

- Desafíos de los datos:

- Después del 30 de abril, las solicitudes de datos de TikTok comenzaron a fallar debido a posibles actualizaciones internas de la API, aunque no se proporcionaron comunicaciones oficiales ni actualizaciones de documentación a los usuarios de la API.

- Limpieza de datos:

- Los datos recopilados se limpiaron eliminando el contenido duplicado y las entradas sin texto significativo, como las que solo tienen emojis o campos vacíos.

- Muestra final:

-

- Después de la limpieza y el filtrado, el conjunto de datos final constó de 86.372 mensajes de TikTok recopilados entre el 1 y el 30 de abril.

Formato de entrega de datos:

- El conjunto de datos final, incluidas las descripciones de los vídeos de TikTok, se entregó como un archivo de texto (.txt) que contenía todas las entradas válidas recopiladas hasta finales de agosto de 2024.

Análisis de datos

El análisis se centrará en identificar las interacciones en las que convergen diferentes formas de odio, utilizando una metodología interseccional para descubrir patrones complejos en el discurso de odio. Se analizarán diecisiete categorías (o variables), incluyendo referencias directas a colectivos concretos como judíos, gitanos, musulmanes, LGTBI e inmigrantes. Además, se examinarán las variables latentes para detectar la presencia de odio, toxicidad y tono emocional en los mensajes utilizando herramientas como Perspective API y SentiStrength.

Entregables y cronograma:

- Entre abril y agosto de 2024: Finalización de la recopilación del corpus de mensajes, que luego se filtrará y se preparará para su posterior análisis.

- 13 de agosto de 2024: Conclusión de la recopilación de datos y elaboración de informes preliminares.

- 30 de septiembre de 2024: Presentación de los expedientes del corpus e informes preliminares (D5.2).

- Octubre de 2024: Todos los investigadores participantes en COIN participarán en un hackathon para analizar datos detallados, que culminará con la presentación final de los informes D5.2 y D5.3 y una evaluación del progreso del WP5 (diciembre de 2024).

- Noviembre de 2024: Preparación y finalización de las bases de datos Data_COIN, incluidos los conjuntos de datos específicos: Data_COIN_X, Data_COIN_Facebook, Data_COIN_Instagram y Data_COIN_TikTok.

Hitos clave:

- Para el 13 de agosto de 2024:

- Un corpus de mensajes en español de las redes sociales (Twitter, Facebook, TikTok e Instagram) en España (archivo .txt):

- Debe representar el periodo de abril a agosto de 2024.

- Incluye mensajes filtrados por idioma y país (cuando sea posible), preparados para su posterior análisis.

- Un corpus de mensajes en español de las redes sociales (Twitter, Facebook, TikTok e Instagram) en España (archivo .txt):

- Durante el proceso:

- Informes periódicos de progreso:

- Hará un seguimiento de la progresión del corpus y de los resultados preliminares del análisis de contenido.

- Debe reflejar los desafíos encontrados y las soluciones implementadas.

- Informes periódicos de progreso:

- Al final del período de recopilación y análisis de datos:

- Informe D5.2:

- Documenta los métodos y resultados del monitoreo de contenido de odio dirigido a varios grupos vulnerables en las redes sociales.

- Incluye estadísticas y ejemplos representativos de contenido de odio detectado.

- Informe D5.2:

-

- Informe D5.3:

- Proporciona un mapeo detallado de las formas de incitación al odio en línea (DATA_COIN).

- Analiza y discute la interseccionalidad en los discursos de odio identificados (documentos en Anexxes).

- Incluye visualizaciones gráficas para ilustrar las interconexiones y la prevalencia de diferentes formas de odio (documentos en Anexxes).

- Informe D5.3:

Línea de tiempo:

- Abril-Agosto 2024:

- Recopilación y filtrado de datos.

- Desarrollo y puesta a punto de detectores.

- Septiembre 2024:

- Análisis preliminar del corpus.

- Ajustes a la metodología si es necesario.

- Elaboración del Informe D5.2.

- Octubre 2024:

- Finalización de la recopilación de datos.

- Presentación del informe D5.2.

- Noviembre 2024:

- Desarrollo de mapas de discursos de odio y análisis de interseccionalidad.

- Elaboración y revisión del Informe D5.3.

- Diciembre 2024:

- Finalización y presentación de informes D5.3.

- Evaluación del WP5 y propuestas para futuras direcciones de investigación (y publicación).

Criterios de éxito y medidas de contingencia

El éxito del Paquete de Trabajo 5 del proyecto COIN se evalúa en base a criterios interrelacionados que aseguran la integridad y pertinencia de la investigación. Un elemento clave es la integridad del corpus, que garantiza que todos los datos necesarios se recopilen de acuerdo con los estándares metodológicos establecidos, asegurando un conjunto de datos completo y representativo. Esto es esencial para la validez de las conclusiones del estudio. Al mismo tiempo, la calidad del análisis desempeña un papel fundamental, ya que la profundidad y la precisión con la que se identifican y categorizan los contenidos de odio influyen directamente en la solidez de los hallazgos. Este análisis detallado es crucial para descubrir los matices y complejidades del discurso de odio en línea dirigido a grupos vulnerables.

Además, el éxito del proyecto COIN se basa en la comunicación efectiva de sus resultados. Las visualizaciones de datos sencillas y bien diseñadas son vitales, ya que permiten a las partes interesadas captar información compleja de forma rápida y precisa, lo que facilita la toma de decisiones informadas basadas en los resultados proporcionados.

En previsión de posibles desafíos, el proyecto ha desarrollado medidas de contingencia para mantener la continuidad y la calidad de su trabajo. En el caso de retrasos en la recopilación de datos o dificultades para acceder a los datos, ya sea debido a altos costos económicos o al cierre parcial o total del acceso, las sesiones adicionales de recopilación de datos son un recurso crucial para recuperar el tiempo perdido y garantizar un volumen de datos suficiente para un análisis exhaustivo. Además, la dependencia del proyecto de API externas presenta una vulnerabilidad a los cambios en su disponibilidad. La adaptación a través de herramientas alternativas o soluciones de software personalizadas garantiza que el proyecto continúe con una interrupción mínima.

En colaboración con:

Proyecto financiado por la Unión Europea. Acciones Marie Skłodowska-Curie – H2020-MSCA-COFUND-2020-USAL4EXCELLENCE-PROOPI-663. Número de acuerdo de subvención: N. 101034371. Referencia interna de USAL: 8925-8553.